/arXiv:2501.19393

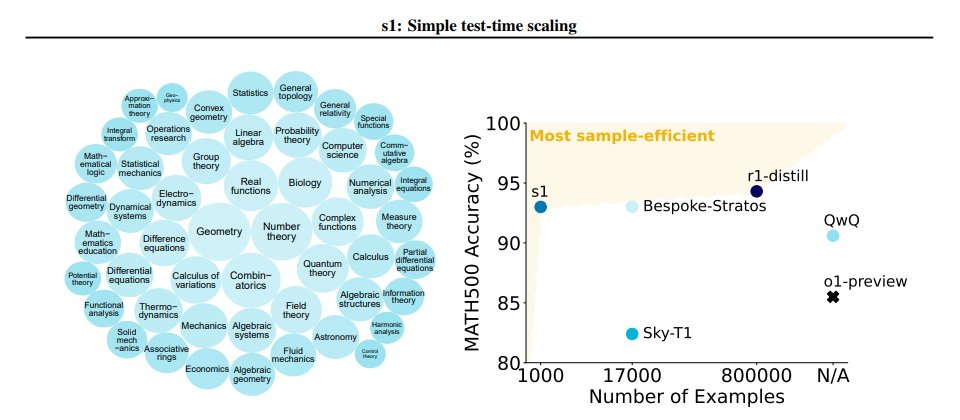

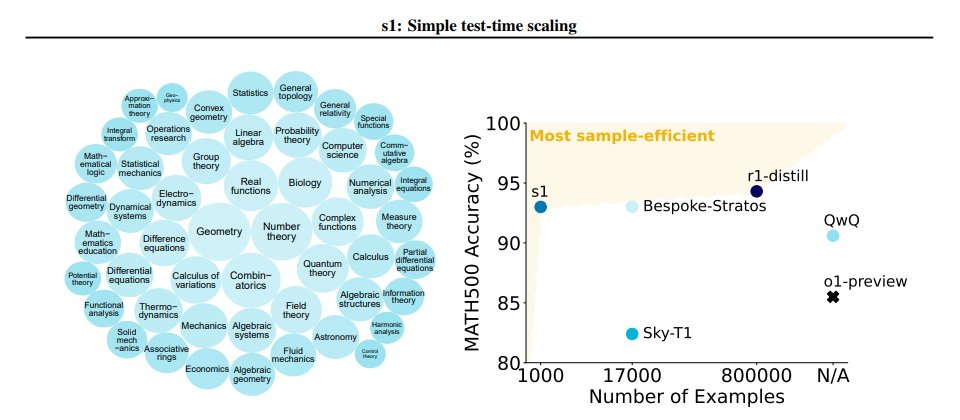

研究團隊也比較了s1-32B和DeepSeek r1和o1,測試結果並不如後二者。但研究團隊解釋,這是因為DeepSeek r1和o1都使用了大量數據進行強化學習,而s1-32B則僅使用1,000個精選資料進行微調,因此仍是最具樣本效率的模型。

本模型已開源於GitHub上。

大學研究人員不斷在以更低成本訓練高效能AI模型。今年初柏克萊大學研究團隊也用了約450美元來訓練效能近似o1-preview的模型。

美國另一研究團隊以20美元開發效能超越o1-preview的AI模型

Share

2025-02-07

2025-02-07

美國華盛頓大學與史丹佛大學的研究團隊揭露降低AI模型開發成本的新方法,以小樣本資料集與20美元硬體費用,也能訓練出推論效能超越o1-preview的AI模型

/arXiv:2501.19393

研究團隊也比較了s1-32B和DeepSeek r1和o1,測試結果並不如後二者。但研究團隊解釋,這是因為DeepSeek r1和o1都使用了大量數據進行強化學習,而s1-32B則僅使用1,000個精選資料進行微調,因此仍是最具樣本效率的模型。

本模型已開源於GitHub上。

大學研究人員不斷在以更低成本訓練高效能AI模型。今年初柏克萊大學研究團隊也用了約450美元來訓練效能近似o1-preview的模型。

Popular selection

Copyright 2022 HUIDU